ハイレゾ・オーディオってなんですか。

この問いに即回答できる方って、結構少ないんじゃないでしょうか。 今回はハイレゾ・オーディオの定義と、それを理解するために必要な信号処理の超入門部分を超ざっくり解説してみようと思います。(デジタル信号処理の部分についてのみの記述で、アナログ部分についての記載はありません。)

ハイレゾ・オーディオってつまり何?

ハイレゾ・オーディオは日本の一般社団法人が呼称を定義し、呼称を普及させようとしている規格です。

ハイレゾ・オーディオの呼称を普及させようとしている団体は、2つあります。

まず、JEITA(一般社団法人電子情報技術産業協会)では”CD スペックを超えるディジタルオーディオ”1と定義しています。

次に、一般社団法人日本オーディオ協会ではより細かく条件が定義されており、サンプリング周波数が96kHz、量子化bit数が24bitの信号処理能力があることと定義しています。2

さて、ここで出てきたサンプリング周波数と量子化bit数とは何でしょうか?

即回答できる方はおそらく下記の内容を読む必要がありません。というか、内容に突っ込みたくなるでしょう。回れ右してどうかおかえりください。。。

この記事は、言葉の雰囲気だけでも掴めたらいいな、と願って書こうとした記事です。

怖い人はいなくなりましたね?

この話に入る前に、まず音というデータがパソコン上ででのように処理されているのかを見てみましょう。

パソコン上で”音”はどう処理されるのか?

パソコンは0と1のデータしか扱えない3という話を聞いたことがある方は多いかと思います。実際に、パソコン上で音声データは0と1の集合によって作られています。

パソコン上での音声データの話をする前に、音がどのような性質を持つものなのか簡単に確認してみましょう。

そもそも音ってなに?

普段、街中を歩いていたり、生活をしていると音が聞こえると思います。例えば、こんな風に。

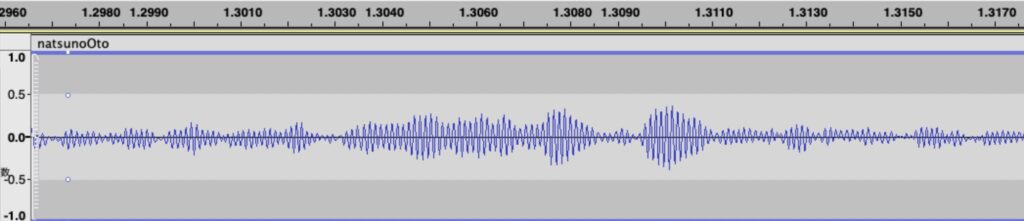

これを波形編集ソフトであるAudacityで見てみると、このような波形が見えてきます。

これが音の正体であり、実際にマイクのコンデンサやコイル、あなたの鼓膜が空気の振動によって受け取ったエネルギー(に近い)ものです。4つまり、音の発生源から発せられた空気の振動を受け取った時の波形を表したものです。

縦軸はその振動の幅(強さ)、横軸が時間経過を表しています。イメージしにくい方は、地震計のイメージ(YouTubeへのリンク)を持ってもらうとわかりやすいかもしれません。

では、これらのデータはパソコン上でどう処理されているのでしょうか?

パソコン上の音声データ

先ほど、パソコン上で音声データは0と1の集合でできている、というお話をしました。0はスイッチオフ、1はスイッチオンになっている状態です。ではなぜこのような形式でデータを保存するのでしょうか?

それは、コンピュータの演算装置であるCPUがそれが得意になるように設計されているからです5。

ところが、現実世界では”0″と”1″だけではなくもっと多くの種類の数字を利用しています。例えば私たちが普段一番よく使うであろう、10進数表現である数値の”256″や”1024″など。それらをコンピュータ上で直感的に処理したいこともあるでしょう。そのような場合、以下の方法でコンピュータに処理させることができます。

まず用語の説明です。”0″or”1″になりうるデータ1つをビットと呼んでいます。そして、これらを8ビット集めたものを一般に1Byteとして扱います。8bit=1Byteということですね。例えば、”00010101″が1Byteのデータを示します。(余談ですが、”00010101″は10進数で”21″を表しています。)

1Byteのデータでは”00000000″~”11111111″、すなわち10進数では”0″~”255″の値を表現することができます。もっと大きな数値を表したければ16bit=2Byte、32it=4Byte、64bit=8Byteといったまとまりでデータを処理することも可能です。

さて、これで”0″と”1″のデータから私たちがよく知っている10進数の数字が表現できるようになりました。

では、先ほどの音声データをどうすればこのような形式に変換できるのでしょうか?

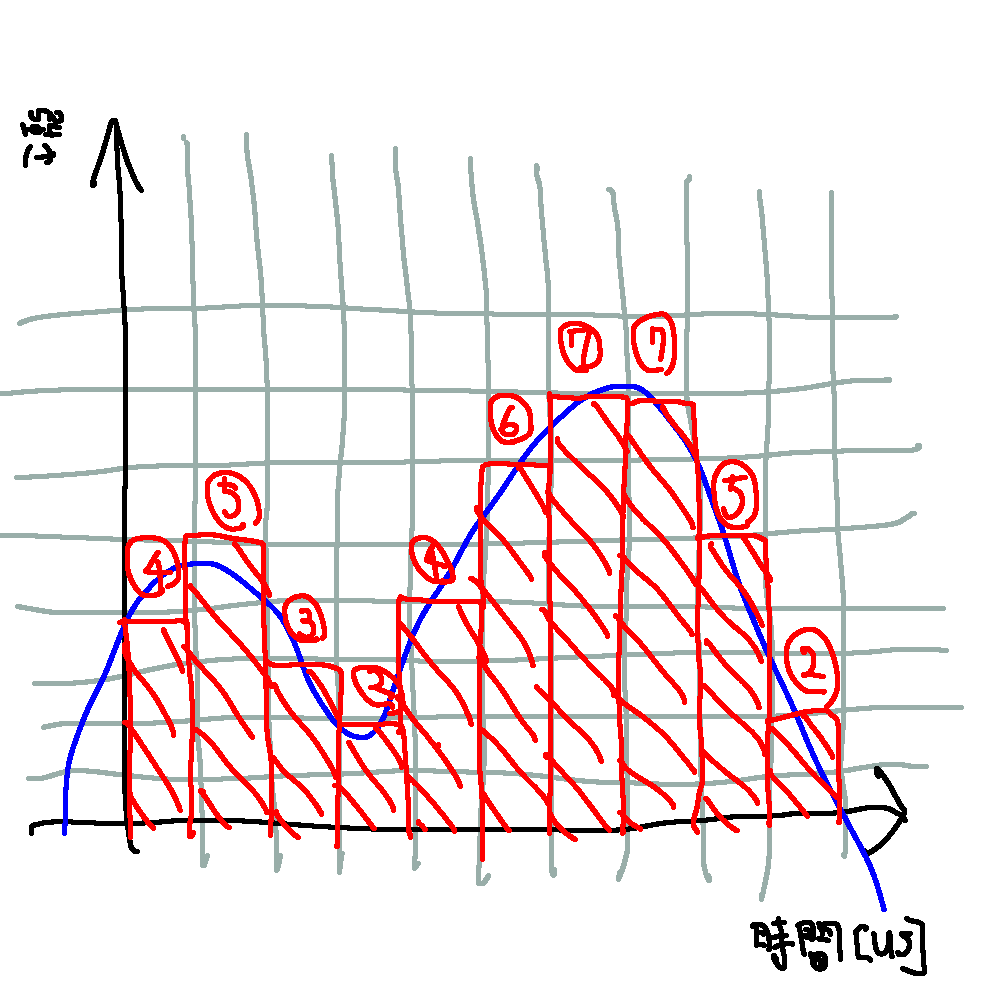

答えは簡単で、まず時間と強さを一定間隔で区切ります。次に音声データの面積がマスの半分をこえている領域を赤く塗りつぶします。この赤く塗りつぶされたマスの数が音声データの値そのものになります。

すなわち、下の結果は2,1,3,3,2となります。

ただ、上記の結果は元の音声データ(青線)とは大きく外れてしまっているように見えないでしょうか。

では、マス目をもっと細かく、縦横2倍の細かさにしてみましょう。より元の音声データ(青線)を表現できていることがわかるかと思います。

この結果は4,5,3,2,4,6,7,7,5,2となります。

上のデータの倍のデータ数になっているのがわかるでしょうか?

この横軸の細かさがサンプリングレートで、縦軸の細かさが量子化bit数ということになります。

CDの音質のサンプリングレートが44.1kHz、量子化bit数が16bitなので、1秒間に44100回の縦軸の区切りが発生します。そして縦軸の区切りは2^16=65536段階になります。

ハイレゾ・オーディオの定義の一つであるサンプリングレート96kHz、量子化bit数24bitは、1秒間に96000回の縦軸の区切りが発生します。そして縦軸の区切りは2^24=16777216段階になります。

これで、サンプリングレートと量子化bit数が雰囲気でわかるようになりましたね。

・・・なってるといいな。

実際にこのデータがどのようにファイルとして保存されているのか気になる方は、非圧縮のデータである.wav形式のデータ構造を確認してみて下さい。ヘッダ+データの単純な羅列、なのでとても単純です。よかったらちらっとみてみて下さい。

で、ハイレゾで音質は変わるの?

諸説あります。

サンプリングレートが高いと、より高い音の表現ができるようになります。可聴領域を超えている音なので意味はないのでは?とも言われていますが、その空間の雰囲気の絶妙な表現などに一役買っている、という話もあります。

量子化bit数が大きいと、音の大きさの表現の幅が広がるので、より細かい音が聞こえやすくなる・・・と思うこともあります。これは個人的にはわかりやすいと思っている箇所で、例えばライブ音源などで観客の咳払いや物音といった細かい音がちゃんと聞こえるな、と思うことがあります。

個人の主観によるところが大きいので、皆さんもいろんな音源を聴いてみて欲しいな、と思います。

ちなみに、普通の音源と、ハイレゾ音源でマスタリング自体が違うものもあります。音圧重視の音作りで、音の波形がほぼ長方形になってしまった音のことを海苔波形とかいうのですが、ハイレゾ音源のものはこの海苔波形から脱却しようとしているものもあり、個人的には嬉しいな、と思っています。

DTMの世界で、海苔波形の良し悪しみたいな話がたまに出ますが6、それはまた機会があれば・・・どこかで。

時間が足らずに結局まとめ切れず、推敲もちゃんとできませんでした。

そのうちリベンジします。ごめんね。

#竹林アドカレ2023

- 25JEITA-CP第42号を参照 ↩︎

- アナログ側の使用など、他の定義については一般社団法人 日本オーディオ協会 | ハイレゾ | ハイレゾロゴ | 定義と運用を参照 ↩︎

- 怖い人に怒られるので、脚注に量子コンピュータ・・・というキーワードだけを入れておきます。 ↩︎

- 厳密にはDSPによる処理が入っていたり、ノイズ成分が付与されているので違いますが、便宜上そう言い切っています。 ↩︎

- CPUはそもそも論理ゲートの集合であって、0と1以外の信号を電気的に判断することはできません。・・・ということにさせて下さい。すごく、嘘をついています。 ↩︎

- 例えば、基音が400Hzぐらいで音が出ているピアノの音があった場合その倍音成分である800Hz、1200Hzなんかの成分に対してイコライザなどを使って細かい調整を行ったりします。あとはコンプレッサーとか(ry ↩︎